BERTで文章のネガポジ判定と根拠の可視化をやってみる

1.はじめに 前回のブログでは、事前学習済みBERTをファインチューニング無しでそのまま使って、センター試験…

AI(人工知能)

AI(人工知能)

1.はじめに 前回のブログでは、事前学習済みBERTをファインチューニング無しでそのまま使って、センター試験…

AI(人工知能)

AI(人工知能)

1.はじめに BERTは、事前学習+ファインチューニングの2段階学習によって、自然言語処理分野における11の…

AI(人工知能)

AI(人工知能)

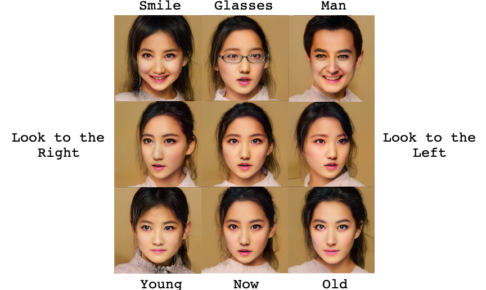

1.はじめに 皆さんは、低解像度の顔画像を高解像度の画像に変換したいと思ったことはありませんか。 2020…

AI(人工知能)

AI(人工知能)

1.はじめに 前回のブログ「GANの潜在空間に新垣結衣は住んでいるのか?」で分かったことは、StyleGAN…

最近のコメント